결국 스티브 잡스 없이 진행된 WWDC 기조연설에서, iPhone의 다음 하드웨어 플랫폼인 iPhone 3G-S가 발표됐다.

특히 관심을 갖고 있던 자동초점, 전자나침반, 음성조작 기능에 대한 대목과, 발표 직후의 리뷰들을 종합해 보면 다음과 같다.

(1) Auto-Focus Camera

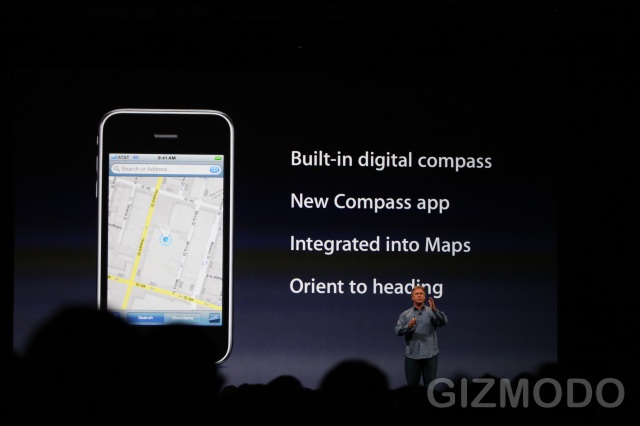

(2) Magnetometer

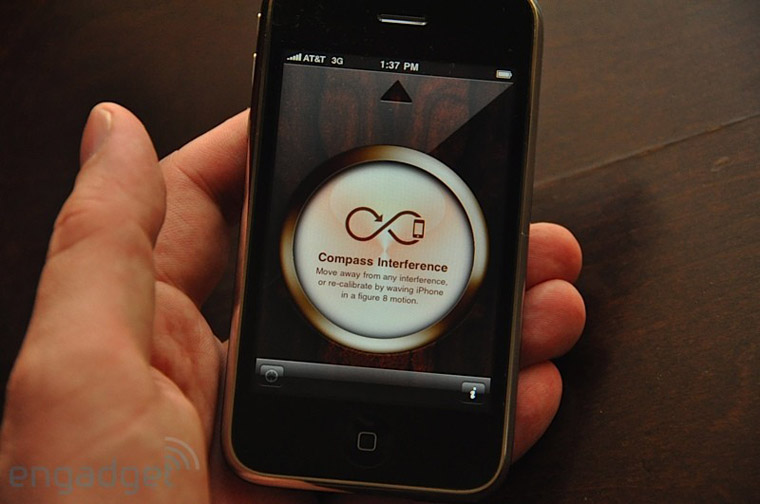

(다음 날 추가) 관련된 내용이 애플 웹사이트에도 올라왔다. "처음 사용할 때 이 calibration 동작을 수행하고, 그 이후에도 종종 해야 합니다. 다시 calibration을 할 필요가 있을 때마다 알려드립니다. ... 또한 자성을 가진 물체로부터 멀리 떨어지라는 안내가 나올 수도 있습니다." ... 흠, 사실 센서신호의 변동폭을 보면 다시 초기화를 해야 할지 안 해도 될지를, 초기화 데이터의 상대적인 차이를 보면 지자기에 의한 건지 지나치게 강력한 다른 자석에 의한 영향인지를 알 수 있겠구나. 과연 애플, 늘 한번 더 생각한 티를 내주신단 말이지. 하나 배웠다. 확실히 HTI는 먼저 해보는 놈을 따를 재간이 없는 듯.

(다시 일주일 뒤 추가) 관련 스크린샷이 올라온 걸 발견. 휴가에서 돌아오자마자 이것부터 업로드하고 있다. -_-a;; 어떻게 돌리느냐에 따라서 감도가 달라질텐데, 그에 대한 상세한 설명은 없다. 왠지 스샷으로만 보기엔 이 '초기화' 동작을 수시로... 심지어 경우에 따라선 제대로 북쪽을 보려면 자리를 옮겨가면서 몇번이나 하고 있어야 할 것 같은 느낌이다. 조금 일렀던 거 아닐까... 어쩌면 센서를 두 개 사용하거나 그냥 여러 방향으로 초기화체조 -_- 를 함으로써, 국지적인 자기장을 제외하는 기술 같은게 나올 수도 있겠다.

(3) Voice Control

VUI 관점에서 iPhone 3G-S의 음성입력(Voice Control) 및 음성출력(VoiceOver)을 보자면, 오래 누르기를 통해서 음성모드로 들어가는 점이나 음성명령을 반복(echoing)함으로써 자연스럽게 명령이 제대로 입력되었는지 확인하고 취소할 시간 여유를 주는 점 등은 가장 전형적인 방법이라고 할 수 있다. 오히려 사용 가능한 음성명령을 재미없는 "명령어 예시 목록" 같은 것으로 나타내지 않고 둥둥 떠다니는 키워드들로 표현한 것이 신선한 정도였다. 반면에 음성인식 중에는 분명히 오류가 발생할 수 있을텐데, 그런 경우를 대비해서 인식결과의 대안을 제시하지 않는다는 부분은 조금 불안한 대목이다. 개인적으로 관심이 가는 것은 역시 VUI의 설계에 대한 부분으로, 무려 32개 언어로 만들어진 유도문(prompt)이 어떻게 각 언어의 특징에 맞게 쓰여졌을까 하는 부분이다. 특히 우리 말로 "Dial 010-2345-6789"같은 내용을 작성하라고 하면 아무래도 자연스럽게 되지 않았기 때문이다. 어떤 식으로 나오든 앞으로는 그게 각 언어의 기능별 조작명령의 표준이 될텐데...

개인적으로 기대는 많이 했지만, 결국 일반적인 음성명령의 적용에 그쳐서 솔직히 실망이다. 물론 이 정도 파급력을 가진 기기의 가장 주요한 기능에 음성UI가 들어간 거고, 무엇보다 다른 어플리케이션으로의 파급력까지 생각한다면 아직 실망은 이르겠지만서도.

결국 한국에 아이폰이 출시되느냐 하는 점은 아쉽게 됐지만, 그래도 재미있어 보이는 기능들이 몇가지나 들어갔으니 몇달간 아이폰을 둘러싼 소식이 끊이지 않을 예정이다. 거기에나 기대해 보자. *_*

반응형