문장을 다른 언어의 문장으로 바꿔주는 "번역"과, 말(음성)을 다른 언어의 말(음성)로 바꿔주는 "통역"은 전혀 차원이 다른 기술이다. 번역은 이미 몇 년전부터 웹사이트를 통해서 많이 제공되고 있고, 문장 단위의 번역에서부터 웹페이지를 통채로 번역해 주는 서비스까지 무료로 제공되기도 한다. 그럼에도 불구하고 음성을 음성으로 통역해 주는 서비스가 제대로 상용화되지 않은 데는 그럴만한 이유가 있다.

문법에 잘 맞게 작성된 문장은 표준적인 방법(형태소 분석, 사전 치환 등)으로 다른 문장으로 만들 수 있다. 하지만, 음성은 아무래도 그 자체로도 문법적으로 완벽하지 않은 데다가, 통역기라는 것이 입력되는 문장이나 단어를 제한하기 어렵고, 그러니 음성인식을 거치면서 더욱 왜곡되어, 번역이 불가능한 정도의 문장(글)으로 오류만 발생시키거나 이상한 번역문과 결국 이해할 수 없게 합성된 말(음성)으로 변환되기 쉽다.

정리하자면, 음성언어(말) 자체의 불완전함, 통역기라는 어플리케이션에서 보장해야 하는 자유도, 음성인식의 높은 오류율, 불완전한 문장의 의미를 유추할 수 없는 대화 분석의 부재, 결과로 나온 문장이 이상할 때 더더욱 이상해지는 음성합성 등 관련된 기술의 약점이 고스란히 드러나는 어플리케이션이 통역기라고 하겠다. 같이 일했던 어떤 분은 통역기 개발을 외줄타기에 비유하곤 했다. 각 모듈간의 입출력에서 한발자국만 삐끗하면 걷잡을 수가 없다는 거다.

그렇기 때문에 "통역기"를 자칭하는 대부분의 서비스들은 대부분 미리 문장을 모두 정의하고 분류해 놓고 그 분류체계를 탐색하는 방식을 쓰거나(엄밀히 말하면 통역이라고 할 수도 없고, 그냥 각 문장에 따라 미리 준비된 통역된 문장을 틀어준다고 봐야 할 것이다), 행여 음성인식을 지원하는 경우라고 할지라도 실제로 단어단어를 번역할 생각을 하기보다 그렇게 준비된 문장을 바탕으로 가장 근접한 결과를 출력해 준다. 그러다보니 쉽게 생각할 수 있는 조합의 문장(예: 가까운 빵집이 어디입니까?)이 아닌 실제 상황에서 쓰이는 문장(예: 여기 뉴욕제과가 어딨죠?)은 사실상 인식이 불가능한 것이다.

난데없이 통역기에 대한 불만(?)을 되새기게 된 것은, 사실은 며칠 전 Apple AppStore에서 발견한 "Jibbigo"라는 통역기 App때문이다.

처음 휴대폰에 들어갈 통역기의 Voice UI를 설계한 게 벌써 몇년 전이다. 오래간만에 비슷한 어플이 나왔길래 "와, 이제는 기술이 좀 쓸만해졌나?"라고 들여다 봤지만, 아무래도 기존에 만들었던 데모 동영상이나 이 회사에서 보여주는 데모 동영상이나 크게 다른 게 없다... 물론 아이폰답게, 터치스크린을 누르고 있는 동안(push-to-talk) 음성을 입력하다가 혀가 꼬이면 (이런 일은 그야말로 비일비재하다) 흔들어서 다시 시작할 수 있는 기능은 잘 넣었다고 생각하지만.

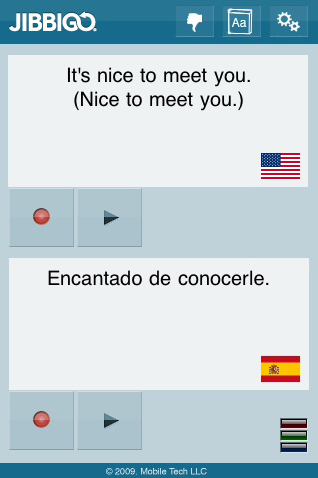

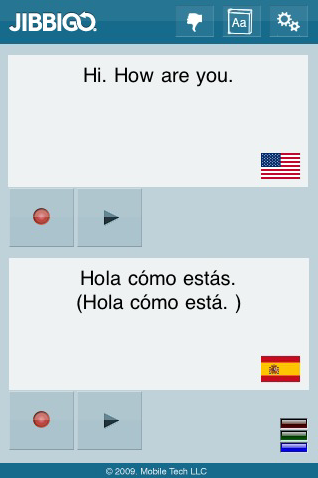

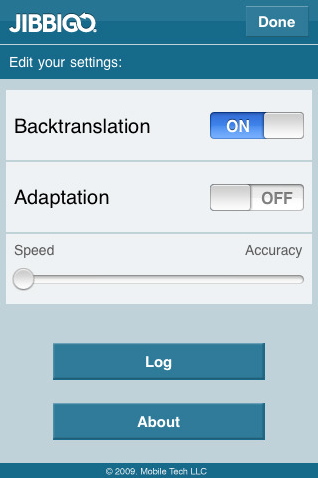

App Store에 올라와 있는 스크린샷을 보면, 가장 일반적인 UI라고 할 수 있다. 위쪽 반에는 음성 인식된 영어 문장이 나타나고, 아래쪽 반에는 찾아진 스페인어 문장이, 반대로 통역하는 경우도 마찬가지다. 각각의 인식 버튼을 누르고 있는 동안에는 음성인식이 진행되고, 플레이 버튼을 누르면 통역된 문장이 음성으로 재생된다.

하지만 좀더 자세히 보면, 화면에 표시된 문장은 직접 음성인식된 결과물은 아님을 알 수 있다. 같은 의미의 다른 문장이 괄호 안에 표시되어 있는 것이다. 결국 미리 적혀있는 한 항목에 최소한 두 가지의 음소열이 연결되어 있어서, 입력된 사용자의 음성이 그 음소열에 가장 가깝다고 나타나면 그 항목의 문자를 화면에 표시하는 것이다. 애당초 다양한 구조와 단어를 포괄하는 구조가 아닌 것이다.

심지어 아래와 같은 동영상까지 올라와 있다.

흠... User Tips라는 제목으로 올라오긴 했지만, 이건 솔직히 어플을 사라는 건지 말라는 건지. -_-a; 특히 음성 대화를 빙자하는 서비스들은 아무리 "여행에서 있을 수 있는 통상적인 시나리오를 대상으로 했다"든가 "주변에 소음이 없도록", "인식이 안 되면 구성을 바꿔봐라"든가 하는 소리를 해봐야 사용자를 제약할 수는 없는 것이다. 결국 3만원이나 하는 소프트웨어치고는 만족도가 높을 리가 없고, 현재 올라온 리뷰 내용은 최하의 별점을 기록하고 있다.

아직 음성-음성 통역기는 역시 무리인가... 현재의 기술로는, 그리고 지난 몇년 간 기술의 발전에도 불구하고 문제는 그대로 남아있다는 사실로 미루어 앞으로도, 그냥 방대한 문장 쌍을 주제에 따라 탐색하거나 키워드로 검색한 다음 음성합성 엔진을 잘 만드는 편이 현실성이 있을런지 모르겠다. (아니 사실 정해진 문장들이라면 합성기를 쓸 필요가 있기는 할까.)

... 아니면 좀더 적극적으로 다른 모달리티를 활용하거나. (아놔.)

문법에 잘 맞게 작성된 문장은 표준적인 방법(형태소 분석, 사전 치환 등)으로 다른 문장으로 만들 수 있다. 하지만, 음성은 아무래도 그 자체로도 문법적으로 완벽하지 않은 데다가, 통역기라는 것이 입력되는 문장이나 단어를 제한하기 어렵고, 그러니 음성인식을 거치면서 더욱 왜곡되어, 번역이 불가능한 정도의 문장(글)으로 오류만 발생시키거나 이상한 번역문과 결국 이해할 수 없게 합성된 말(음성)으로 변환되기 쉽다.

정리하자면, 음성언어(말) 자체의 불완전함, 통역기라는 어플리케이션에서 보장해야 하는 자유도, 음성인식의 높은 오류율, 불완전한 문장의 의미를 유추할 수 없는 대화 분석의 부재, 결과로 나온 문장이 이상할 때 더더욱 이상해지는 음성합성 등 관련된 기술의 약점이 고스란히 드러나는 어플리케이션이 통역기라고 하겠다. 같이 일했던 어떤 분은 통역기 개발을 외줄타기에 비유하곤 했다. 각 모듈간의 입출력에서 한발자국만 삐끗하면 걷잡을 수가 없다는 거다.

그렇기 때문에 "통역기"를 자칭하는 대부분의 서비스들은 대부분 미리 문장을 모두 정의하고 분류해 놓고 그 분류체계를 탐색하는 방식을 쓰거나(엄밀히 말하면 통역이라고 할 수도 없고, 그냥 각 문장에 따라 미리 준비된 통역된 문장을 틀어준다고 봐야 할 것이다), 행여 음성인식을 지원하는 경우라고 할지라도 실제로 단어단어를 번역할 생각을 하기보다 그렇게 준비된 문장을 바탕으로 가장 근접한 결과를 출력해 준다. 그러다보니 쉽게 생각할 수 있는 조합의 문장(예: 가까운 빵집이 어디입니까?)이 아닌 실제 상황에서 쓰이는 문장(예: 여기 뉴욕제과가 어딨죠?)은 사실상 인식이 불가능한 것이다.

난데없이 통역기에 대한 불만(?)을 되새기게 된 것은, 사실은 며칠 전 Apple AppStore에서 발견한 "Jibbigo"라는 통역기 App때문이다.

처음 휴대폰에 들어갈 통역기의 Voice UI를 설계한 게 벌써 몇년 전이다. 오래간만에 비슷한 어플이 나왔길래 "와, 이제는 기술이 좀 쓸만해졌나?"라고 들여다 봤지만, 아무래도 기존에 만들었던 데모 동영상이나 이 회사에서 보여주는 데모 동영상이나 크게 다른 게 없다... 물론 아이폰답게, 터치스크린을 누르고 있는 동안(push-to-talk) 음성을 입력하다가 혀가 꼬이면 (이런 일은 그야말로 비일비재하다) 흔들어서 다시 시작할 수 있는 기능은 잘 넣었다고 생각하지만.

App Store에 올라와 있는 스크린샷을 보면, 가장 일반적인 UI라고 할 수 있다. 위쪽 반에는 음성 인식된 영어 문장이 나타나고, 아래쪽 반에는 찾아진 스페인어 문장이, 반대로 통역하는 경우도 마찬가지다. 각각의 인식 버튼을 누르고 있는 동안에는 음성인식이 진행되고, 플레이 버튼을 누르면 통역된 문장이 음성으로 재생된다.

|

|

|

하지만 좀더 자세히 보면, 화면에 표시된 문장은 직접 음성인식된 결과물은 아님을 알 수 있다. 같은 의미의 다른 문장이 괄호 안에 표시되어 있는 것이다. 결국 미리 적혀있는 한 항목에 최소한 두 가지의 음소열이 연결되어 있어서, 입력된 사용자의 음성이 그 음소열에 가장 가깝다고 나타나면 그 항목의 문자를 화면에 표시하는 것이다. 애당초 다양한 구조와 단어를 포괄하는 구조가 아닌 것이다.

심지어 아래와 같은 동영상까지 올라와 있다.

흠... User Tips라는 제목으로 올라오긴 했지만, 이건 솔직히 어플을 사라는 건지 말라는 건지. -_-a; 특히 음성 대화를 빙자하는 서비스들은 아무리 "여행에서 있을 수 있는 통상적인 시나리오를 대상으로 했다"든가 "주변에 소음이 없도록", "인식이 안 되면 구성을 바꿔봐라"든가 하는 소리를 해봐야 사용자를 제약할 수는 없는 것이다. 결국 3만원이나 하는 소프트웨어치고는 만족도가 높을 리가 없고, 현재 올라온 리뷰 내용은 최하의 별점을 기록하고 있다.

아직 음성-음성 통역기는 역시 무리인가... 현재의 기술로는, 그리고 지난 몇년 간 기술의 발전에도 불구하고 문제는 그대로 남아있다는 사실로 미루어 앞으로도, 그냥 방대한 문장 쌍을 주제에 따라 탐색하거나 키워드로 검색한 다음 음성합성 엔진을 잘 만드는 편이 현실성이 있을런지 모르겠다. (아니 사실 정해진 문장들이라면 합성기를 쓸 필요가 있기는 할까.)

... 아니면 좀더 적극적으로 다른 모달리티를 활용하거나. (아놔.)

반응형